Yapay zeka kamera başta olmak üzere kişisel verilere erişebiliyor mu?

Mardin Artuklu Üniversitesi Yapay Zeka ve Bilişim Sistemleri Koordinatörü aynı zamanda teknoloji transfer ofisinde Girişimcilik ve Şirketleşme Birim Koordinatörü Dr. Mehmet Tarık Baran, gündemde olan ve çoğu kişinin merak ettiği yapay zekanın kamera başta olmak üzere kişisel verilere erişe bilirliği hakkında İLKHA mikrofonuna önemli açıklamalarda bulundu.

Dr. Baran, insan beynindeki nöronlar gibi özellikler oluşturan yapay zekanın kamera ve diğer özel verilere erimişi hususunda kişinin iznine tabi olduğunu belirtti. Baran, ancak, yapay zekayla ilgilenen kişinin inisiyatifi ve siber güvenlik noktasında verilen erişime ulaşılabileceğini belirtti.

Herhangi bir videoyu alıp kullanma kısmının yapay zekanın kendisinin değil, yapılan ara yüzün işlemi olduğunu ifade eden Baran, yapay zekanın arka planda veri işleyen algoritma olduğunu, ön planda ise tıpkı bir web sitesinin tasarımı gibi bir tasarım olduğunu kaydetti. Bunu da izinlere bağlı olarak video olarak kişilerin sesi kullanılabilir ve veriler alınabileceğini aktardı.

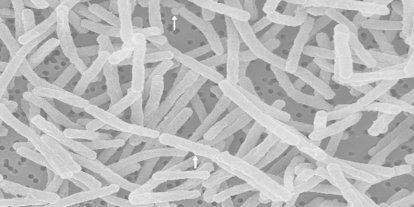

Yapay zekanın tanımını yapan Baran, "Yapay zeka, hakkında toplumumuz dışardan sanki her şeyi kontrol edecekmiş, tek başına hareket edecekmiş gibi algılıyoruz. Yapay zeka algoritmaları ya da modelleri kendi içerisinde eğitilmiş, daha öncesi belirlenen verilerden ve data setlerden herhangi bir konuda özelleşmiş de olabilir ya da genel bilgiler içerebilir. Bunlarla eğitilmiş ve insan beynindeki nöronlar gibi nöronlar ve özellikler oluşturur; ve herhangi bir yazı, video, ses, sinyal gibi bir girdi verdiğimiz zaman, bunlara en uygun cevabı oluşturabilen algoritmalar ve sistemlerdir." dedi.

"Kişisel verileri alınabilir mi? Bu tamamen tasarımı yapan kişinin inisiyatifine kalır"

Baran, yapay zekanın ara yüzü işlemi hakkında bilgi vererek, "Videoyu alıp kullanma kısmı ise, aslında yapay zekanın kendisinin değil, yapılan ara yüzü işlemidir. Bilgisayar dilinde, ön planda kullanılan ve görünen kısmına özel bir isim verilir; ayrıca arka planda kullanılan kısımlar da vardır. Yapay zeka aslında bizim arka planda veri işleyen algoritmadır. Ön planda işleyen ise tıpkı bir web sitesinin tasarımı gibi bir tasarımdır. Bunu da izinlere bağlı olarak video olarak kişilerin sesi kullanılabilir ve veriler alınabilir. Aynı şekilde, bazı sosyal medya platformlarında herhangi bir beğeni ya da yorumdan sonra daha alakalı videolar ya da ona benzer içerikler alınması tamamen alt yapı sebebidir. Ama bunu yapan yapay zeka değil, ara yüz denilen görünen kısım daha çok bunu yapar. Kişisel verileri alınabilir mi? Bu tamamen tasarımı yapan kişinin inisiyatifine kalır." ifadelerini kullandı.

"İzin verilmeden herhangi bir mikrofondan ses ya da kameradan görüntüyü alıp işleyemezler"

Sözlerinin devamında Baran, "Gizlilik sözleşmesinde eğer bu inisiyatif alınmışsa ve siz de buna izin vermişseniz, videoya ya da sesin alınmasına, sonrasında istedikleri kadar veriyi toplayıp ikinci ya da üçüncü şahıslara paylaşılmasına izin verilebilir. Genellikle gizlilik sözleşmelerini okumadan onayladığımız oluyor. Ancak bu tür sözleşmelerin ciddi anlamda okunup irdelenmesi gerekir. Kişisel veriler kullanıldığı zaman tüm bu veriler bir serverda toplanır ve ilgili şirket ya da uygulama bunu alıp yapay zekada işletip size bu doğrultusunda sonuçlar verebilir. Büyük şirkette bunu göze alamazlar, bu tamamen bir trajedidir onlar için. Kişinin hiçbir izni olmadan hiçbir veri kullanılamaz. Gizlilik sözleşmesine, kişiyle erle ilgili verilerin toplanıp gönderileceği yer vardır. Kişi de bunu kabul etmişse hatta okumamışsa da buradan belli veriler alınabilir. Fakat izin verilmeden herhangi bir mikrofondan ses ya da kameradan görüntüyü alıp işleyemezler." şeklinde konuştu.

"Siber güvenlik dünyasında izinsiz de erişim mümkündür"

ChatGPT veya benzeri modellerin çalışırken kullanıcının kamerasına erişme ihtimali sorusuna cevaben Baran, "Chat GPT gibi yapay zeka modelleri (Large Language Models – LLM) Büyük Dil Modelleridir. Bunların birçok çeşidi var; hatta spesifik özelleşmiş küçük dil modelleri, daha spesifik dil modelleri, videoyu, sesi ve diğer yapıları da işleyebilen karmaşık modeller de mevcut. Çok yönlü (Multimodal) modeller olarak geçerler. Multimodal modellerde birçok çeşit veriyi alıp işleyip sonuç verebiliyor. Ancak bunu yapay zekanın kendisi değil, ara yüzü yapar. Bu ara yüz tasarımında verileri alma yetkisini önceden tanımlamamışsa ve kişi de buna izin vermişse alınır. Peki, izin olmadan alınabilir mi? Bu tamamen siber güvenlik dünyasında bunun olabilirliği kanıtlandı, bunlar yapılabiliyor. Fakat bunları yapabilip yapılamadığını ancak arka planda ağ analiziyle anlayabiliriz. ChatGPT’nin ve buna benzer diğer modellerin bunları yapıp yapmadığıyla ilgili bu tür büyük şirketler genellikle yapma taraftarı olmazlar. Kişisel verilerle ilgili çok ciddi davalar açılır. Böyle bir girişim olmaz. Ama kötü niyetli olabilecek kişiler var. Sonuçta niyete bağlı. Verilerin tamamını toplayıp, işleyip ardından analiz edip satabilirler; bu tamamen onların kendi niyetlerine bağlı bir durumdur. Bu niyete sahip kişilerin ilgili şirket olup olmadığıyla ilgili tabii ki bilgimiz yok, ancak kendilerinin ağ analizi yapılıp bunların kendilerine sorulması gerekir. Sosyal medyada çıkan videolar hakkında kullanıcılara tavsiyemiz şu: 'Siz izni vermediğiniz sürece ve gizlilik sözleşmelerini dikkatli okuduğunuz sürece, hiçbir verinizi hiç kimse başka ikinci ya da üçüncü şahıslarla paylaşamaz, hatta kendi bünyelerinde tutamazlar'. Kendi bünyelerinde eğitim amaçlı tutup kullanma yetkileri gizlilik sözleşmelerinde olabilir, ama bunu kişinin izni olmadan yine yapamazlar." şeklinde ifade etti.

Siber güvenlik açısından, kişisel cihazlardaki kamera ve mikrofonun ele geçirilmesi hakkında konuşa Baran şu ifadelere yer verdi:

"Bu, tamamen siber güvenlik ile ilgili alakalı olup yapılabiliyor. Küçük programlarla, 'rat' (uzaktan erişim aracı) denilen programlarla, hatta Metasploit denilen programlarla sistem açıklarını kullanarak belli portların açılıp bunlardan küçük algoritmaların yüklenmesiyle bilgisayarın bütün kontrolü de ele geçirilebiliyor. Sadece kamera veya ses değil. Her güncelleme ile bu açıklar kapatılıyor. Yapay zeka şirketleri bunu yaparlar mı? Yapay zeka şirketleri, tabii ki yapabilirler, ama bunu yapma refleksine gireceklerini düşünmüyorum. Bunu yapmaları kendileri için trajedi olur, çünkü ciddi anlamda insan haklarına ve kişilik haklarına müdahale olmuş olur. ChatGPT’ye yazılan özel sorular misali. Çok yetkinliği olan bir araç. Bu sebepten dolayı bunu yapacaklarını düşünmüyorum. Ancak yapma yetkinlikleri var mı? Oradaki mühendislerin yapma yetkinlikleri mevcut, ama bunu da kişiden izin almadan ancak yasa dışı yollarla yapabilirler."

"Temiz bilgiye ulaşmak için de mutlaka ciddi araştırmalar yapılmalıdır"

Baran, kullanıcıların gerçek bir güvenlik ihlali ile sosyal medya manipülasyonun ayırt edilmesi hususunda, "Şimdiki zaman diliminde gerçek ile sanal bile ayırt etmemizin zorlaştığı bir zamandayız, her iki bilgiyi birbirinden ayırt etme neredeyse imkansız hale gelmiş. Bu sebepten dolayı da bilgi kirliliği de gitgide artmakta. Bu artan bilgi kirliliği kafalarda soru işareti oluşturuyor ve bunu da sosyal medyada tabii basit amaçlarla (beğeni toplama amacıyla) farklı videolarla çevirmek için kullanıyorlar. Eğer bunların hepsini biz dikkate alır ve ona göre davranırsak tamamen paranoid bir hal almış oluruz. Kullanıcılar olarak, birincisi gördüğümüz şeylerin artık hepsini geçmişteki gibi kabul etmememiz lazım. Bunları acaba yapay zeka ile mi yapıldı, yoksa insan tarafından mı yapıldı? Bunun bilinmesi gerekiyor. Temiz bilgiye ulaşmak için de mutlaka ciddi araştırmalar yapmamız, temiz bilgiye nasıl ulaşacağımızı, bunların yönlerini ve yöntemlerini öğrenmemiz gerekiyor."

"Sadece gönüllü olarak yapılan, ticari amaç gütmeyen yerlerden doğrulama yapılabilir"

Baran, "Yapay zekanın kendisinin bile halüsinasyon riski vardır. Halüsinasyon, kendi içinde olmayan bir veri sorulduğunda uydurma yetisidir. Bu da aynı sosyal medyada görülen içeriklerin gerçeklik algısıyla eşdeğer bir durumdur. Onda da yanlış bir şeyi kabullenme riski vardır. Bu konuda bence kabullenmek yerine araştırmak lazım. Alınacak herhangi bir veri veya çıktı, mutlaka özellikle de bilimsel kaynaklardan araştırıp doğrulanmalıdır. Öbür türlü sadece kafalarda birikmiş kirli bilgilerle ve sadece dezenformasyona bağlı her şeye inanma dürtüsü oluşur, başka hiçbir şey olmaz. Ancak doğru bilgiyi hangi kaynaklardan ulaşılacağı bilinirse en azından kişi kendi hayatında da doğrunun üzerine doğru katarak devam etmiş olur. Peki doğru bilgiye nerden ulaşırız? Bununla ilgili birçok veri tabanı var, ancak hangisi doğru? Her veri tabanının veya kaynağının ayrı ayrı -internetten, hatta Google aramalarından bile yanlış verilere veya dezenformasyonlara ulaşabiliriz. Birçok insanın sadece gönüllü olarak yaptığı, ticari amaç gütmeyen yerlerden bunların doğrulaması yapılabilir. 'Acaba bizi görüyor mu, videoyu kullanıyor mu?' kısmının ise doğrulamasını tabii ki kendileri deneyerek de bulabilirler. Bizler de bunları görünce kendimiz de deneriz. Daha önce kamera erişimi vermediğiniz herhangi bir yapay zeka uygulamasını açıp, bunlarla sesli konuştuğunuz sırada kamerayı karşınıza bir şey koyduğunuzda 'Bunu tanımla' dediğiniz zaman, kamera erişimi olmadığı için size 'Ben bunu yapamıyorum, göremiyorum' diyecektir. Bunu hatta defalarca söylemenize rağmen söylemeyecektir. Ama önceden kamera iznini vermişseniz ve bu uygulama hem video, hem ses, hem sinyal kullanan çok yönlü (multimodal) modellerden biriyse, mutlaka size karşınızda olan nesneyi veya olayı tarif edebilir." diye belirtti.

"İnsanların düşünmekten yorulduğu, makinaların ise düşünmeye başladığı bir çağa giriyoruz"

Gelecekte yapay zekanın işlevi ve insanların durumuna dikkat çeken Baran, "Gelecekte yapay zeka artık 'Bizim bu korkunç bir şeyi hayatımıza koymamamız lazım' denilmesi gereken bir şeyin dışına çıktı. Artık hayatımızın gerçekliği oldu. Nasıl ki belli dönemlerde belli çağlar kapanıp belli çağlar açıldıysa bu da öyle. İnsanların bu konuda dikkatli olması gerekiyor. Makinaların düşünebildiği, kendi içerisine veri alıp işleyip en mantıklı sonucunu çıkarabildiği bir çağa girdik. Böyle bir çağda akademisyenler olarak gözden kaçırdığımız şeyler var: insanlar tembelliğe doğru gidiyor, araştırmamaya doğru gidiyor, doğrulamayı yapmıyor. Hatta öğrencilerimiz bile artık yapay zekaya yazıp sonuçları alıp kopyala-yapıştır yapıyorlar. İnsanların düşünmekten yorulduğu, makinaların ise düşünmeye başladığı bir çağa giriyoruz. Böyle bir çağda hem doğru bilgiyi, hem de aldığımız herhangi bir bilginin sorgulanabilir olduğunu bilmemiz gerekiyor ve bunları sürekli sorgulamamız lazım." dedi.

"Yapay zekayı öğrenmemiz, her bilgisini sorgulamamız, nasıl çalıştığını irdelememiz gerekiyor"

Baran, yapay zekanın gelecekte mesleklerin yerini alacağı söylemine karşı, "Bununla ilgili birçok alanda çalışmalar var ve artık durdurulamaz bir durumda. Biz bunu kabullenip hatta içerisine girmemiz gerekir. Çünkü bu yeni meslekler oluşturacak. En büyük korkularımızdan biri de seminerlerimde en çok sorulan sorudur. 'Meslekler ölecek mi?' Eğer bunu kabullenmemiş ise, o dönüşümün içinde olunmayacağı için muhtemelen kendi mesleğinizi yapamaz bir durumda görüneceksiniz. Aslında yapıyorsunuz da ama daha profesyonel, daha iyi yapan biri sizden öne geçebilir. Bu sebepten dolayı yapay zekayı öğrenmemiz, her bilgisini sorgulamamız, nasıl çalıştığını irdelememiz gerekiyor. Artık kendi kendine çalışan, hatta kendi kendine ameliyat yapan modeller bile var. İnsan elinde değmeden ameliyat yapan modeller Stanford Üniversitesi ve John Hopkins Üniversitesi tarafından tanıtıldı. Bu modeller çok profesyonel ve gelecekte hata oranları düşük olduğu için muhtemelen hayatımıza girecek." şeklinde aktardı.

Tembelliğe düşmemek için yapılması gerekenleri aktaran Baran, şunları kaydetti:

"Bilgiye hızlı ulaşma herkesin isteği ama bu bilgiye hızlı ulaşmanın yollarını öğrenmemiz lazım. Sadece alıp kabullenmek değil, irdelemek, doğrulamak ve bu bilgilere kendi bilgilerimizi de katmak. Peki, bu sadece ChatGPT'den kopyala-yapıştır şeklinde mi? Tabii ki hayır. Belli konularda bize çok büyük faydaları var, işlerimizi hızlandırmada çok yardımcı olur. Ancak söylediği her şey kabul edilmemeli, aldığımız bütün verileri kendi yaptığımız verilerle değiştirebiliriz. Bu bizi tembellikten kurtarır. Onunla birlikte çalışmamız ise bizi profesyonel hale getirir; bazen kuracağımız cümleler hakkında bile fikir verebiliyor. Kendi bilgimiz ve cümlelerimizi kurup üzerine onun yardımını almamız bence çok daha iyi olur. İnsan merkezli, makine yardımlı bir düşünceyle hareket etmemiz çok daha verimli olacaktır."

Geliştirdikleri yapay zeka modelleri hakkında kısaca değinen Baran, "Mardin Artuklu Üniversitesi bünyesinde, yaptığımız modeller arasında cilt hastalıklarını tespit eden hem de yüksek doğrulukta yüzde 98'e yakın bir doğrulukta tespit modellerimiz var. Mardin Atatürk Üniversitesi'nde yeni yapay zeka birimini kurduk. Ama bu ekosistemi oluşturup, hatta birçok kurumumuzla ve akademik alandaki birçok üniversitemizle ortak iş birliği yapıp, bunları ileriye götürmeyi düşünüyoruz. Bunlarla ilgili adım attıklarımız da var. Birçok yerde ilerleme kaydettik. Bunların arasında tarımla ilgili uydudan toprak analizi modellerinden, sağlıkta hastalık tespitine kadar hatta bir hastanın muayeneye geldikten tedavisini aldıktan sonra gittiğinde onun tekrar muayeneye gelip gelmeyeceğini yüzde 85 doğrulukta tahmin eden modelimiz bile var." dedi.

Kaynak:İLKHA

Türkçe karakter kullanılmayan ve büyük harflerle yazılmış yorumlar onaylanmamaktadır.